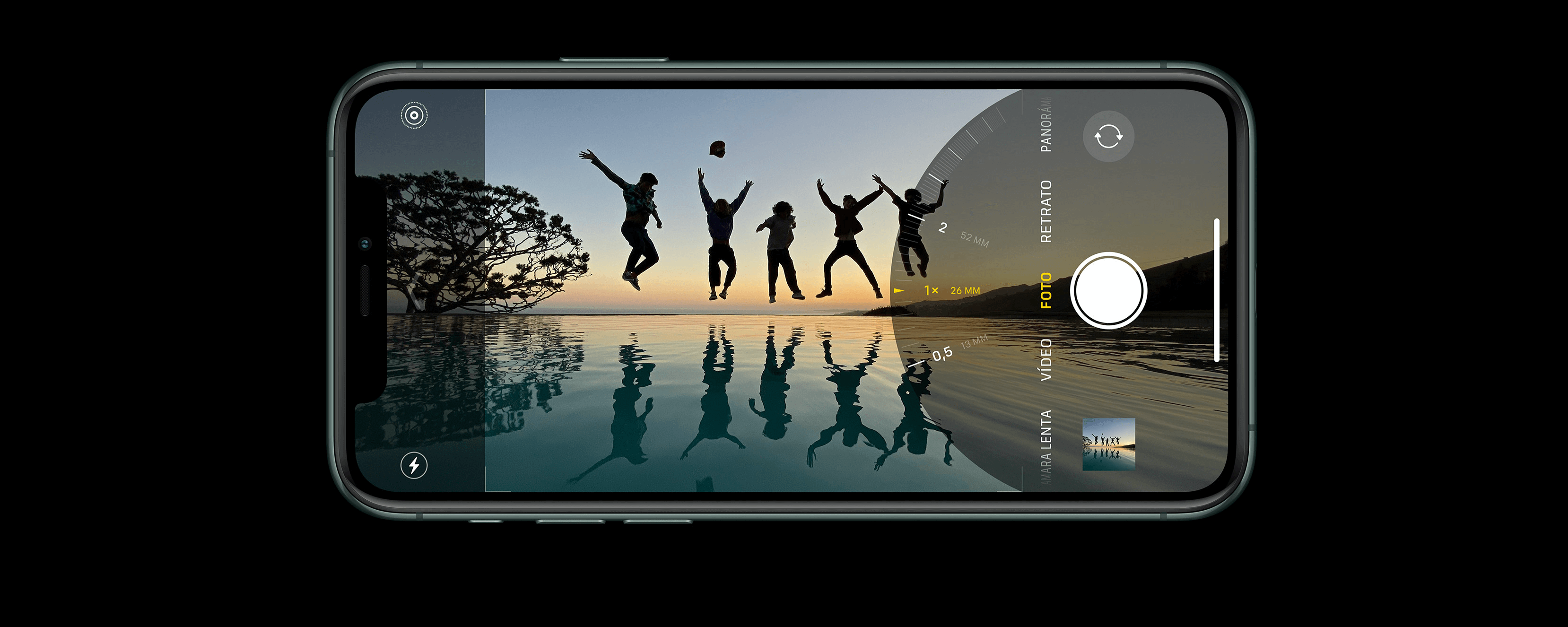

Con la llegada de los iPhone 11 llegaron también nuevas cámaras. Ahora tenemos al sucesor del iPhone XR con doble cámara mientras su versión Pro alcanza las tres. Aunque esta mejora en las cámaras es algo que ya sabíamos a partir de algunos rumores lo cierto es que la sorpresa llegó de la mano del software.

El nuevo chip A13 Bionic, responsable del funcionamiento de los nuevos iPhone trae bajo el brazo varios componentes específicos para el manejo de la información de la cámara y el procesado de las fotografías.

En este artículo vamos a analizar qué es la fotografía computacional, hablaremos del modo nocturno y del futuro Deep Fusion, el que podemos considerar el futuro de la fotografía.

Menos cámaras, más procesador y sobretodo software

Las cámaras de los dispositivos móviles hace tiempo que han llegado prácticamente al máximo de sus posibilidades de mejora en cuanto a componentes. La miniaturización que se necesita para que las cámaras quepan en un dispositivo como un iPhone obliga a simplificar mecanismos, lentes, sensores, etc. Y aunque puede quedar algún margen de mejora lo cierto es que los cambios importantes se producen por otro frente.

Sin ponernos técnicos en el tema, si comprobamos las especificaciones de las diversas cámaras para móvil que hay en el mercado veremos que son realmente parecidas, al final estas cámaras solo se "limitan" a captar la información y es en el procesado de la misma donde las diferencias salen a relucir.

Y es en el procesado donde los nuevos iPhone 11 y iPhone 11 Pro destacan. A través de su chip A13 Bionic hacen uso de la inteligencia artificial para entrar en lo que se conoce como fotografía computacional.

Este chip tiene componentes específicos para procesar las más de un billón de operaciones por foto que realiza. De hecho cuenta con varios coprocesadores específicamente diseñados para ocuparse de partes del proceso como el HDR, el cálculo de la fusión de fotografías o el calculo de profundidad de la misma. Todo esto orquestado por un motor neuronal capaz de entender la semántica de la fotografía para aplicar de forma inteligente los cambios sobre la misma.

Cómo se "generan" las fotos en un iPhone 11

Vamos a tomar por ejemplo una fotografía con modo retrato con la luz a espaldas del sujeto de modo que estamos a contraluz, el mismo ejemplo que expuso Apple durante la keynote.

Lo primero que ocurre es responsabilidad de las tres cámaras del dispositivo que toman ocho fotos con cada disparo, cuatro principales y cuatro secundarias. Las cuatro principales tienen diferentes exposiciones para el HDR y para poder rescatar los detalles tanto de las zonas más oscuras como de las más claras. Las cuatro secundarias sirven para calcular la exposición, el balance de blancos, el foco y el mapa de tonos.

Hecho esto el procesador de señales de imagen (ISP, ya tenemos un componente más) va a coger la información de las 8 fotografías de las cámaras y las va a combinar en una sola imagen. Pero todo esto se hará de forma acompasada y siguiendo las instrucciones de los algoritmos de machine learning.

A través de este machine learning el procesador de entendimiento de imagen es capaz de entender que se trata de una persona y que la luz viene de su espalda de modo que la cara queda oscurecida y por lo tanto que, en general, la foto no está compensada. Estas conclusiones son posibles gracias a cuatro capas de información que alimentan al motor neuronal: detección facial, rasgos del rostro, máscara de segmentación de imagen y semántica de imagen. Con esta información extra nuestro iPhone sabe detectar la cara de la persona (ojos, nariz, boca, ovalo facial...) y al hacerlo decide utilizar imágenes capturadas con mayor iluminación para la zona de la cara, dando como resultado la mejor fotografía posible de entre la información capturada, con una cara iluminada y con todos los detalles.

¿Y el modo nocturno?

Cuando en el momento de capturar el iPhone detecte demasiada poca luz en la imagen va a pasar automáticamente al modo nocturno. En el modo nocturno se repite la forma de "generar" la fotografía pero cambia ligeramente la forma de capturarla.

Cuando la iluminación es insuficiente lo primero que hace el sistema es determinar si lo que estamos tratando de fotografiar esta quieto o en movimiento. Si predomina la quietud, el iPhone hará diversas capturas de larga exposición para poder captar todos los detalles, si por el contrario hay movimiento las capturas serán más cortas en exposición y hará más cantidad.

Luego esta información se combinará como hemos explicado en el apartado anterior, utilizando las mejores exposiciones, reduciendo el ruido, y combinando la información para que el resultado final sea el mejor posible.

Deep Fusion, lo que está por venir

Todo este proceso que hemos explicado, tanto en el modo normal como en el modo nocturno viene gobernado por el ISP (el procesador de señales de imagen) y está apoyado con el motor neuronal del A13 Bionic. Pero Apple presentó ayer un paso más en este campo. Las fotografías enteramente procesadas por inteligencia artificial.

Deep Fusion, que podemos traducir como "fusión profunda", en referencia a las redes neuronales profundas que lo alimentan, entrará de lleno en la fotografía computacional y nos proporcionará imágenes imposibles de obtener con ninguna cámara.

Con este modo activado nuestro iPhone procesará pixel por pixel los 2.400.000 pixeles de cada fotografía, buscando entre 9 mejores versiones (recordemos que se capturan 4 imágenes principales y 4 secundarias más una de larga exposición extra propia de este modo) para conseguir una calidad en el detalle totalmente asombrosa. Y todo eso en un solo segundo.

Esta función llegará seguramente en otoño de la mano de iOS 13.2 y sin duda nos muestra la siguiente gran innovación de la fotografía, la fotografía computacional.

Artículos relacionados: